Dans les échanges autour de l’intelligence artificielle générative que nous avons dans les séminaires IA que nous organisons ou les missions d’accompagnement que nous réalisons, une confusion revient de manière récurrente : celle entre le modèle de langage et le service d’IA qui le met à disposition. Cette confusion est compréhensible. Les outils les plus visibles donnent l’impression d’une IA « clé en main », homogène, dont les capacités et les limites seraient intrinsèques à la technologie elle-même. Pourtant, cette vision masque une réalité plus nuancée et surtout plus déterminante pour certains choix à opérer.

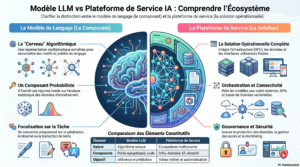

Derrière une interface simple se superposent en réalité plusieurs briques aux rôles très différents. Le modèle de langage constitue le socle technique : il porte un potentiel, des biais, des capacités et des limites propres. Le service d’IA, quant à lui, transforme ce potentiel en une expérience encadrée : il impose des règles d’usage, conditionne les flux de données, façonne les interactions et détermine, in fine, ce que l’utilisateur peut réellement faire… ou non.

Ne pas distinguer ces deux niveaux conduit à des raccourcis fréquents : surestimer ou sous-estimer les capacités réelles d’une IA, croire maîtriser ses données alors que les dépendances se déplacent, ou encore former les utilisateurs à des pratiques difficilement transférables d’un outil à un autre. À l’inverse, faire cette distinction permet de poser les bonnes questions : évalue-t-on un potentiel technologique ou un service donné ? Cherche-t-on de la simplicité d’usage ou de la maîtrise ? De l’expérimentation rapide ou une intégration durable dans les processus métiers ?

Cet article propose de clarifier cette différence, non pour entrer dans un débat technique, mais parce qu’elle conditionne directement la manière dont l’IA générative peut, ou pas, créer de la valeur dans les organisations. Comme nous le verrons, c’est souvent moins le modèle lui-même que la plateforme qui l’expose qui détermine les usages possibles, les risques réels et les marges de manœuvre à long terme.

1. LLM : le cœur technique de l’intelligence artificielle

Un LLM est un modèle d’intelligence artificielle entraîné sur une très grande quantité de texte. En répétant cela à grande échelle, il capte des régularités du langage lors de son entrainement et parvient à générer en retour du langage naturel cohérent. Il faut avoir en tête que les LLMs sont entraînés sur la quasi-totalité du web et… plus encore… Cette caractéristique n’est pas sans rapport avec les questions voire problèmes rencontrés dans l’utilisation de ces outils comme nous le détaillerons un peu plus loin : propriété intellectuelle, biais, qualité des productions, etc.

Quelques exemples de LLM :

- Mistral Large de la société Mistral AI (français)

- GPT-5.2 de la société OpenAI (américain)

- Claude 4.5 Sonnet et Claude 4.5 Opus de la société Anthropic (américain)

- Llama 3.3 de la société Meta (américain)

- DeepSeek-V3 de la société DeepSeek (chinois)

- Qwen 3 de la société Alibaba (chinois)

2. Plateformes d’IA : du modèle au service

Un service d’IA générative est une solution, prête à l’emploi, qui peut intégrer un ou plusieurs LLM dans une infrastructure technique et fonctionnelle. Elle fournit à ses utilisateurs différents services qui s’appuient notamment sur les capacités des LLMs.

Exemples de services d’IA générative :

- ChatGPT de OpenAI s’appuie sur plusieurs LLM : GPT-5.2, GPT-4o

- Le Chat de Mistral AI s’appuie sur le LLM Mistral Large

- Claude.ai de Anthropic s’appuie sur le LLM Claude 4.5

- Copilot de Microsoft s’appuie sur le LLM GPT-4

- Delibia de Delibia (startup française) s’appuie sur le LLM Mistral AI

Toutes ces plateformes de services d’IA générative sont assez similaires en termes de services et proposent à leurs utilisateurs une interface sous forme de chat pour dialoguer avec le LLM. Les utilisateurs peuvent ainsi :

- Etre aidés dans la rédaction d’un mail

- Résumer un article

- Etre redirigés vers des ressources sur internet au regard d’un sujet

- …

Il existe de nombreux autres usages impossibles à lister ici de manière exhaustive.

Pour reprendre une analogie régulièrement utilisée, le LLM peut ainsi être considéré comme le moteur du véhicule que serait la plateforme de services d’IA générative. Il en est la pièce centrale qui produit la puissance, mais il ne peut pas fonctionner seul : il faut du carburant, un système de refroidissement, une transmission. Il n’a pas d’interface utilisateur (pas de volant, pas de tableau de bord). Par ailleurs, il peut être installé dans différents véhicules qui ne présentent pas les mêmes caractéristiques et n’ont pas les mêmes finalités (une ambulance, un camion de pompiers, un bus).

3. Pourquoi c’est important de faire cette distinction

3.1 Données des usagers : la vraie question de contrôle

La confusion LLM/service masque parfois un enjeu crucial pour les acteurs publics : où transitent les données des usagers et des administrations ?

Déployer un LLM comme Mixtral (Mistral AI) ou Llama 3.1 (Meta) est parfois perçu comme une garantie de contrôle accru sur les données. En pratique, cette garantie est loin d’être automatique. Un modèle ne fonctionne jamais seul : son exploitation repose sur une infrastructure technique, des outils logiciels, des mécanismes de sécurité et, très souvent, une couche de services fournie par des tiers. Ce sont ces briques (hébergement, orchestration, supervision, journalisation, politiques de modération) qui déterminent où transitent les données, comment elles sont traitées et qui en garde la maîtrise.

La protection des données des usagers ne dépend donc pas uniquement du choix du modèle, mais de la capacité à maîtriser l’ensemble de la chaîne technologique : infrastructure, couche de services, règles d’usage et pratiques internes. Sans cette vision globale, le risque est de croire à un contrôle accru, alors que les dépendances et les zones d’ombre se sont simplement déplacées.

3.2 L’IA en action : potentiel vs limitations imposées

Les capacités d’un LLM et ce que l’utilisateur observe réellement à l’écran sont souvent deux réalités différentes. Un modèle comme GPT-4, Mixtral ou Llama 3.1 dispose, par nature, de capacités étendues : génération de texte et d’images, reformulation, raisonnement, analyse de documents complexes, voire production de contenus sensibles. Cependant, ces capacités brutes sont systématiquement encadrées, filtrées ou restreintes par les plateformes qui exposent les modèles.

La couche de services d’une plateforme définit des politiques d’utilisation qui peuvent limiter la génération de certains contenus : représentations de nudité ou de violence, propos grossiers, contenus politiques ou médicaux, instructions techniques jugées risquées, ou encore production d’informations non vérifiées. Ces restrictions ne traduisent pas nécessairement une incapacité du modèle, mais un choix de conception du service, destiné à réduire les risques juridiques, éthiques ou réputationnels du fournisseur.

Pour les acteurs publics, cette distinction est déterminante. Tester un LLM via un service grand public revient à évaluer le modèle à travers le prisme des règles imposées par la plateforme, et non à mesurer ses capacités réelles ou son adéquation à des usages métiers. Deux services s’appuyant sur un même modèle peuvent ainsi produire des réponses très différentes, tant en termes de contenu que de comportement, en fonction de leurs politiques de modération, de leurs paramètres par défaut ou de leurs fonctionnalités complémentaires.

Comprendre cette différence permet d’éviter des conclusions erronées, comme considérer qu’un modèle est inadapté à un usage administratif, alors que ce sont en réalité les politiques d’utilisation du service qui en limitent l’expression. Ainsi, en fonction des objectifs, il peut s’avérer essentiel de dissocier l’évaluation de la capacité d’un LLM et l’expérience offerte par une plateforme s’appuyant sur ce LLM.

3.3 Comment utiliser au mieux l’IA

La confusion entre LLM et plateforme peut conduire à attribuer à « l’IA » des comportements qui relèvent en réalité du service qui l’embarque. Lorsqu’un utilisateur interagit avec une plateforme de service, il ne dialogue pas directement avec le modèle dans sa forme brute, mais avec une expérience conçue : formulation des réponses, gestion du contexte, mémorisation des échanges, suggestions automatiques, voire incitations implicites sur la manière de poser des questions.

Cette médiation a un impact direct sur les pratiques. Par exemple, les recommandations courantes autour du « prompt » (être précis, structurer sa demande, donner du contexte, etc.) sont souvent présentées comme des règles universelles liées aux LLMs. En réalité, elles sont fortement influencées par la manière dont la plateforme interprète, reformule ou enrichit les requêtes avant de les transmettre au modèle. Deux plateformes s’appuyant sur un même LLM peuvent ainsi nécessiter des styles d’interaction sensiblement différents pour produire des résultats pertinents.

Pour les organisations, cet aspect est loin d’être anodin. Former des agents à « bien utiliser l’IA » sans expliciter ce qui relève du modèle et ce qui relève du service revient à transmettre des pratiques parfois difficilement transférables d’un outil à un autre. Un agent formé sur une interface grand public pourra se retrouver en difficulté face à un assistant métier reposant pourtant sur le même LLM, mais exposé via une plateforme différente, avec d’autres règles et d’autres contraintes.

À plus long terme, cette distinction influence également la manière dont sont conçus les usages. Penser en termes de plateforme amène à s’interroger sur l’intégration de l’IA dans les processus existants, sur les rôles respectifs de l’humain et de l’outil, et sur les mécanismes de contrôle ou de validation nécessaires. À l’inverse, se focaliser uniquement sur le LLM peut conduire à surestimer l’autonomie de l’outil et à sous-estimer l’importance du cadrage, de l’accompagnement et de la gouvernance des usages.

POUR ALLER PLUS LOIN

Beewant est une plateforme d’intelligence artificielle multimodale développée par la société éponyme. La plateforme met à disposition plusieurs modèles de langage (LLM) de référence : Qwen-3, DeepSeek R1, Kimi K2, Mistral Large 3, GPT-5.2, Claude4.5 et Gemini-3. Les quatre derniers sont accessibles via API et offrent une expérience spécifique par rapport aux services fournis directement par leurs éditeurs :

- Mistral Large 3 via le Chat Mistral

- GPT-5.2 via ChatGPT

- Gemini-3 via Google Gemini

Ce qui distingue Beewant d’un service éditeur standard, c’est sa capacité à transformer le potentiel brut des LLM en un service contextualisé et sécurisé, adapté aux besoins spécifiques des organisations publiques :

- Intégration du contexte organisationnel : organigrammes, acronymes, noms propres, données internes, pour que les réponses tiennent compte des réalités de l’organisation.

- Encadrement de l’usage via des règles, des filtres et des mécanismes de contrôle, réduisant les risques liés aux données et aux contenus générés.

- Choix de modalités techniques d’accès et d’hébergement adaptées aux exigences de maîtrise des données et de conformité des collectivités et administrations.

- Génération automatisée de contenu (comptes rendus, courriers), traitement de tâches complexes (vérification réglementaire, synthèse de dossiers) et automatisation fiable de workflows sensibles, le tout en préservant la souveraineté des données.

En pratique, alors que le LLM fournit la puissance et les capacités, Beewant structure le service pour transformer ce potentiel en usages réellement exploitables, fiables et sécurisés, offrant ainsi plus de maîtrise et de pertinence qu’un service générique proposé par l’éditeur. Pour les acteurs publics, cette approche facilite l’adoption de l’IA générative tout en garantissant que les usages sont alignés avec les contraintes métiers, de sécurité et de gouvernance.

En conclusion

Derrière une apparente simplicité d’usage, l’IA générative repose sur une superposition de briques dont les rôles sont très différents. Le LLM constitue le socle technologique, avec ses capacités, ses limites et ses enjeux propres. La plateforme de services, quant à elle, façonne l’expérience utilisateur, encadre les usages et conditionne, dans une large mesure, les effets réels de l’IA dans les organisations.

Les plateformes comme Beewant illustrent cette différence. En intégrant le contexte organisationnel, en encadrant l’usage des modèles et en proposant des modalités d’accès adaptées, elles transforment le potentiel brut des LLM en services fiables, sécurisés et pertinents pour les collectivités et administrations. Comprendre ce rôle spécifique du service permet d’éviter les raccourcis, de mieux évaluer les outils et de construire des usages durables et maîtrisés de l’IA.

En pratique, distinguer le LLM du service qui l’expose est un préalable indispensable pour poser les bonnes questions : s’agit-il d’évaluer un potentiel technologique ou un service complet ? Cherche-t-on la simplicité d’usage ou la maîtrise des données ? L’expérimentation rapide ou l’intégration durable ? Les réponses orientent des choix stratégiques qui conditionnent la réussite des projets d’IA dans les organisations publiques.

Beewant est partenaire de Metapolis dans le cadre du Lot 2 « IA : Accompagnement spécifique, distribution, hébergement et exploitation de solutions IA » du marché « Services innovants : Intelligence artificielle et environnements Open Source » proposé par la Centrale d’Achats Numérique de Gigalis.

Pour en savoir plus, n’hésitez pas nous contacter :

Gigalis https://gigalis.org/contact/